再次澄清不影響隱私,蘋果透露將向第三方App開放兒童安全防護相關技術

【此文章來自:Mashdigi】

雖然強調與美國國家失蹤與受虐兒童中心 (NCMEC)合作,藉由分散資料串比對方式確認使用者上傳至iCloud的照片是否違規,但不少市場看法仍擔心蘋果此項設計將嚴重影響使用者隱私安全。而在稍早對外聲明與澄清說法中,蘋果透露將向第三方App提供此項機制,另外也宣布將把相關安全機制延伸至iMessage,以及Siri等服務。

蘋果並未因為市場質疑或批評而調整原本作法,反而更堅定地將先前提出兒童安全防護作法延伸至iMessage與Siri等服務,預計在今年秋季陸續更新至iOS 15、iPadOS 15、macOS Monterey及watchOS 8等裝置上使用。

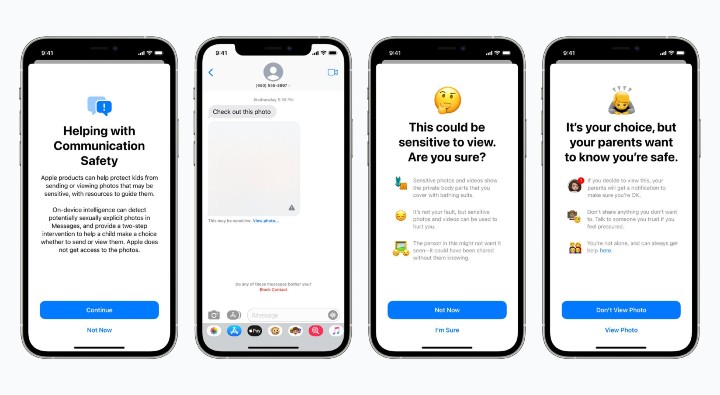

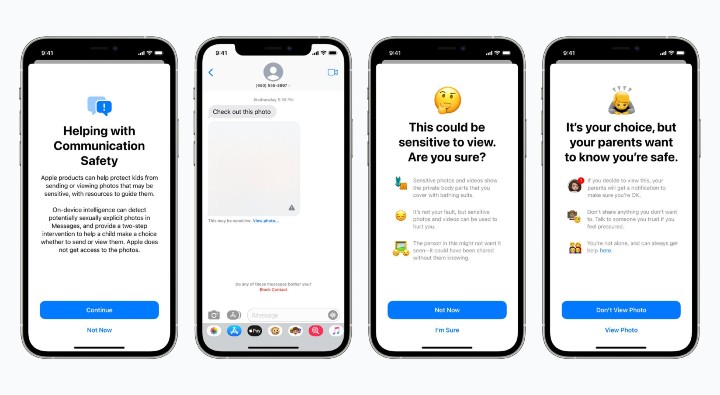

其中,一旦iMessage接收或發送色情內容 (透過相同分散資料比對方式)時,系統就會自動發出警告,若是在開啟家長模式的裝置上,則會同步通知父母,另外也會自動將照片內容以人工智慧方式模糊處理。而在Siri等服務應用中,則會讓使用者更容易透過口語方式詢問通報虐童行為,以及相關求助方式,讓使用者能更方便透過蘋果裝置救助他人,或是進行自我保護。

而先前與美國國家失蹤與受虐兒童中心合作部分,蘋果也強調會維持施行,藉此減少透過蘋果裝置、服務傳遞危害兒童的色情照片等內容。另一方面,蘋果則是再次強調此項機制並不會直接掃描使用者存放照片內容,而是以分散資料與美國國家失蹤與受虐兒童中心所提供資料進行特徵比對,藉此判斷使用者是否上傳色情照片。

在相關說明中,蘋果透露將會向第三方App提供技術,藉此協助避免更多影響兒童安全情況發生,同時也說明此項技術將不會由蘋果獨佔,而是希望透過眾人協助減少兒童受虐問題。

更將安全機制延伸至iMessage與Siri等服務

雖然強調與美國國家失蹤與受虐兒童中心 (NCMEC)合作,藉由分散資料串比對方式確認使用者上傳至iCloud的照片是否違規,但不少市場看法仍擔心蘋果此項設計將嚴重影響使用者隱私安全。而在稍早對外聲明與澄清說法中,蘋果透露將向第三方App提供此項機制,另外也宣布將把相關安全機制延伸至iMessage,以及Siri等服務。

蘋果並未因為市場質疑或批評而調整原本作法,反而更堅定地將先前提出兒童安全防護作法延伸至iMessage與Siri等服務,預計在今年秋季陸續更新至iOS 15、iPadOS 15、macOS Monterey及watchOS 8等裝置上使用。

其中,一旦iMessage接收或發送色情內容 (透過相同分散資料比對方式)時,系統就會自動發出警告,若是在開啟家長模式的裝置上,則會同步通知父母,另外也會自動將照片內容以人工智慧方式模糊處理。而在Siri等服務應用中,則會讓使用者更容易透過口語方式詢問通報虐童行為,以及相關求助方式,讓使用者能更方便透過蘋果裝置救助他人,或是進行自我保護。

而先前與美國國家失蹤與受虐兒童中心合作部分,蘋果也強調會維持施行,藉此減少透過蘋果裝置、服務傳遞危害兒童的色情照片等內容。另一方面,蘋果則是再次強調此項機制並不會直接掃描使用者存放照片內容,而是以分散資料與美國國家失蹤與受虐兒童中心所提供資料進行特徵比對,藉此判斷使用者是否上傳色情照片。

在相關說明中,蘋果透露將會向第三方App提供技術,藉此協助避免更多影響兒童安全情況發生,同時也說明此項技術將不會由蘋果獨佔,而是希望透過眾人協助減少兒童受虐問題。

廣告

網友評論 0 回覆本文