觀點/Google 以 AI 加持單鏡頭、品牌廠商採多鏡頭規格,那種設計比較好?

【此文章來自:Mashdigi】

從此次Pixel 3系列相機設計來看,可以明顯看出Google依然偏重以人工智慧技術滿足絕大部分的拍攝需求,但相比其他合作廠商多半採用雙鏡頭以上設計,甚至三星稍早推出的2018年款Galaxy A9更搭載4鏡頭設計。那麼,手機鏡頭究竟是多好,還是像Google認為以人工智慧彌補一切的好?

▲ 以目前Google在手機主相機設計想法,依然維持以人工智慧搭配運算晶片,讓單一鏡頭即可完成多數拍攝需求的哲學。

在目前市面手機普遍傾向採用雙鏡頭主相機模組設計,例如蘋果在今年推出的iPhone XS系列、iPhone XR均採用雙鏡頭模組設計的主相機,而Android平台機種則是在很早之前就已經在主相機採用雙鏡頭設計,甚至一般入門、中階機種也都開始採用雙鏡頭模組設計,而如華為P20 Pro、LG旗下V40 ThinQ、Nokia即將推出新機更在主相機採用3鏡頭模組設計,藉此對應長焦、超廣角等拍攝需求。

不過,Sony除了在今年推出的Xperia XZ2 Premium首次採用雙鏡頭模組設計的主相機,在後續推出的Xperia XZ3則是維持使用單一鏡頭模組的主相機設計,與Google始終以來推出的Pixel系列維持採用單一鏡頭模組情況相同,認為藉由單一鏡頭就能完成所有拍攝需求的話,實際上並不需要額外增加多組鏡頭造成拍攝效果調整上的困擾。但從Sony堅持立場與Google看法比較的話,可以發現前者其實是以相機設計思維打造手機鏡頭,而後者則是以軟體思維建構相機硬體設計。

▲ 此次Pixel 3系列均維持採單一1220萬畫素鏡頭構成的主相機,以及雙800萬畫素鏡頭透成的視訊鏡頭設計。

▲ 在2017年提出的研究項目中,Google便以人工智慧演算法讓單一鏡頭即可完成拍攝嚴苛夜間影像需求,並且讓雜訊抑制處理變得相當自然,甚至能讓鏡頭捕捉極低光源環境下的景象。

而上述兩個項目,便構成今年推出的Pixel 3相機表現重點,藉由人工智慧軟體演算,搭配Pixel Visual Core (VPU)協助運算,讓手機能在短短時間內完成複雜運算,藉此達成以單一鏡頭完成擷取多組最佳影像,並且合成單張最佳表現結果,或是快速擷取景深資訊構成自然的人像拍攝結果,甚至可以在最快時間內完成嚴苛低光環境下的拍攝影像,並且確保影像細節與雜訊處理結果,同時也能避免高光過曝情況。

因此即便Google強調以人工智慧建構最佳拍攝結果,但背後依然需要足夠硬體運算效能配合。因此在先前的訪談中,Google表示在Pixel 3系列提供的拍攝功能,目前並不會完整下放給其他Android平台手機,即便以Android One形式設計的手機產品也未必能獲得此類功能。

但Google方面自然也未將話說死,言下之意也暗示若其他手機也搭載VPU等獨立運算晶片情況下,事實上也能對應相同效果。

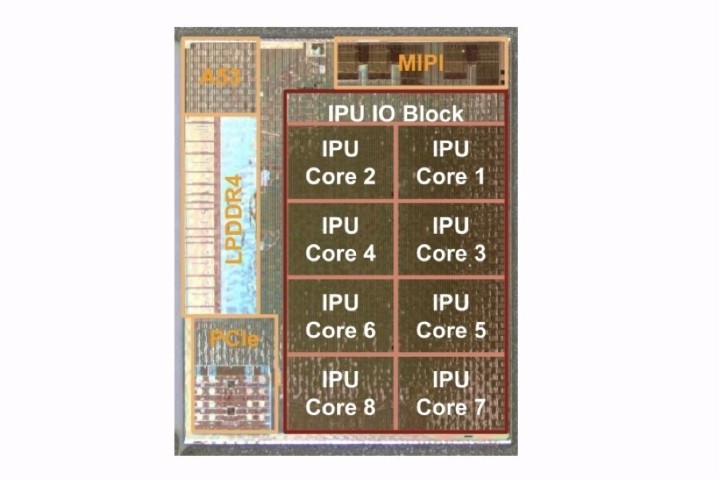

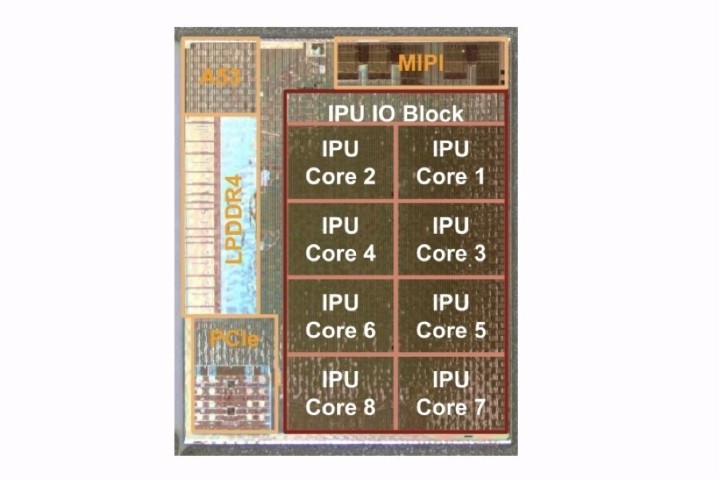

▲ Google去年與Intel以Movidius旗下VPU設計為基礎,打造應用在Pixel 2系列中的客製化運算晶片Pixel Visual Core,此次也同樣在Pixel 3系列採用相同設計。

以先前Sony曾說明在Xperia XZ Premium、Xperia XZs提供的3D人像建模功能僅能透過Motion Eye感光元件模組使用,但後續證實只要處理器運算效能足夠,依然可藉由安裝開發者抽取APK檔案,使用相同3D人像建模功能的情況來看,多半是軟硬體配合上的問題,只是實際運作效能表現可能還是會有落差。

回到Pixel 3的相機功能,確實有不少拍攝需求必須配合VPU加速處理,但如果像Google表示所有功能API均以開放形式提供,並未限制特定硬體使用的話,理論上還是可以藉由手機既有硬體效能運作使用,但多半會有處理時間落差、相容性等表現問題。

原因很簡單,因為要實現像Pixel 3那樣的拍攝效果,顯然必須額外搭載一組獨立處理器,因此多半會增加手機設計成本,另一方面則是端看手機相機設計需求而定,例如Pixel 3在前置相機採雙鏡頭模組設計,原因在於超廣角鏡頭與一般廣角鏡頭拍攝結果,難以透過單組鏡頭實現,在這樣的情況下就必須採多鏡頭切換拍攝。

同時因為直接採用不同鏡頭規格,可以輕易地滿足景深資訊擷取、拍攝廣角或遠距影像,在拍攝功能設計僅需切換不同鏡頭操作,應用在一般入門或中階手機產品的話,相對能有較快生產效率,同時整體成本考量也較具優勢,除非日後在軟體演算效率與硬體配合有更大進展,或是VPU等獨立運算元件成本大幅降低,否則對於非旗艦等級手機而言,透過多鏡頭滿足各類拍攝需求會比較容易實現。

▲ 三星日前揭曉的4鏡頭主相機手機:2018年款Galaxy A9。

因此從三星近期推出搭載4鏡頭主相機的2018年款Galaxy A9,其實就是透過多鏡頭設計滿足不同拍攝需求,其中更透過超廣角、遠距鏡頭滿足單一鏡頭無法實現拍攝效果。

至於Google是否對多鏡頭模組設計不感興趣?其實也不盡然,實際上內部確實有多鏡頭模組測試,例如在這次推出的Pixel 3系列便在前置相機採雙鏡頭設計,滿足單一鏡頭難以同時實現廣角、超廣角兩種拍攝模式,而未來如果有更多拍攝需求的話,其實也不排斥在主相機導入多鏡頭設計。

若是考慮軟體運算與硬體切換效益,以及實際拍攝需求考量,理論上多鏡頭相機發展應該會是未來趨勢,畢竟再考量未來諸如擴增實境、影像識別等應用,在硬體效能尚未有大幅度提昇情況下,多鏡頭設計應該還是未來發展方向,藉由多鏡頭輔助也能減緩影像資訊擷取時所耗費運算效能,進而提昇整體運算效率。

只是鏡頭越多並不代表能帶來更好拍攝效果,主要還是看實際拍攝使用需求,以及產品本身訴求體驗,否則單方面增加鏡頭數量,除了額外增加耗電,更可能讓手機內部空間安排變得複雜,甚至佔用電池擺放空間。

▲ LG V40 ThinQ在主相機採用一般廣角、超廣角與遠焦鏡頭,視訊鏡頭則採用不同廣角設計的兩組鏡頭構成。

因此在正常設計之下,主流手機相機鏡頭數量應該還是會控制在1-2組,除非像P20 Pro、Mate 20系列、V40 ThinQ、2018年款Galaxy A9有特殊使用需求,使得相機數量增加至3-4組。

以目前Google看法而言,自然還是維持以單一鏡頭滿足絕大多數拍攝需求,但在明年推出的Pixel新機是否還會維持單一鏡頭設計,就看屆時市場技術發展與實際需求而定。

從此次Pixel 3系列相機設計來看,可以明顯看出Google依然偏重以人工智慧技術滿足絕大部分的拍攝需求,但相比其他合作廠商多半採用雙鏡頭以上設計,甚至三星稍早推出的2018年款Galaxy A9更搭載4鏡頭設計。那麼,手機鏡頭究竟是多好,還是像Google認為以人工智慧彌補一切的好?

▲ 以目前Google在手機主相機設計想法,依然維持以人工智慧搭配運算晶片,讓單一鏡頭即可完成多數拍攝需求的哲學。

在目前市面手機普遍傾向採用雙鏡頭主相機模組設計,例如蘋果在今年推出的iPhone XS系列、iPhone XR均採用雙鏡頭模組設計的主相機,而Android平台機種則是在很早之前就已經在主相機採用雙鏡頭設計,甚至一般入門、中階機種也都開始採用雙鏡頭模組設計,而如華為P20 Pro、LG旗下V40 ThinQ、Nokia即將推出新機更在主相機採用3鏡頭模組設計,藉此對應長焦、超廣角等拍攝需求。

不過,Sony除了在今年推出的Xperia XZ2 Premium首次採用雙鏡頭模組設計的主相機,在後續推出的Xperia XZ3則是維持使用單一鏡頭模組的主相機設計,與Google始終以來推出的Pixel系列維持採用單一鏡頭模組情況相同,認為藉由單一鏡頭就能完成所有拍攝需求的話,實際上並不需要額外增加多組鏡頭造成拍攝效果調整上的困擾。但從Sony堅持立場與Google看法比較的話,可以發現前者其實是以相機設計思維打造手機鏡頭,而後者則是以軟體思維建構相機硬體設計。

▲ 此次Pixel 3系列均維持採單一1220萬畫素鏡頭構成的主相機,以及雙800萬畫素鏡頭透成的視訊鏡頭設計。

以人工智慧完成所有演算背後,依然需要硬體支撐

從Google先前投入實驗項目來看,其實就曾展示在連拍64張照片之後,透過系統背後的演算法挑選所有照片最好部分進行合成,最後即可實現維持暗部純黑、同時維持明亮度拍攝細節的照片。而去年推出Pixel 2系列機種時,更證實與Intel合作客製化處理晶片Pixel Visual Core,後續則確認是以Intel收購新創公司Movidius旗下VPU技術為基礎,協助手機以獨立影像處理效能完成繁複運算流程。

▲ 在2017年提出的研究項目中,Google便以人工智慧演算法讓單一鏡頭即可完成拍攝嚴苛夜間影像需求,並且讓雜訊抑制處理變得相當自然,甚至能讓鏡頭捕捉極低光源環境下的景象。

而上述兩個項目,便構成今年推出的Pixel 3相機表現重點,藉由人工智慧軟體演算,搭配Pixel Visual Core (VPU)協助運算,讓手機能在短短時間內完成複雜運算,藉此達成以單一鏡頭完成擷取多組最佳影像,並且合成單張最佳表現結果,或是快速擷取景深資訊構成自然的人像拍攝結果,甚至可以在最快時間內完成嚴苛低光環境下的拍攝影像,並且確保影像細節與雜訊處理結果,同時也能避免高光過曝情況。

因此即便Google強調以人工智慧建構最佳拍攝結果,但背後依然需要足夠硬體運算效能配合。因此在先前的訪談中,Google表示在Pixel 3系列提供的拍攝功能,目前並不會完整下放給其他Android平台手機,即便以Android One形式設計的手機產品也未必能獲得此類功能。

但Google方面自然也未將話說死,言下之意也暗示若其他手機也搭載VPU等獨立運算晶片情況下,事實上也能對應相同效果。

▲ Google去年與Intel以Movidius旗下VPU設計為基礎,打造應用在Pixel 2系列中的客製化運算晶片Pixel Visual Core,此次也同樣在Pixel 3系列採用相同設計。

以先前Sony曾說明在Xperia XZ Premium、Xperia XZs提供的3D人像建模功能僅能透過Motion Eye感光元件模組使用,但後續證實只要處理器運算效能足夠,依然可藉由安裝開發者抽取APK檔案,使用相同3D人像建模功能的情況來看,多半是軟硬體配合上的問題,只是實際運作效能表現可能還是會有落差。

回到Pixel 3的相機功能,確實有不少拍攝需求必須配合VPU加速處理,但如果像Google表示所有功能API均以開放形式提供,並未限制特定硬體使用的話,理論上還是可以藉由手機既有硬體效能運作使用,但多半會有處理時間落差、相容性等表現問題。

為什麼品牌廠商依然要推多鏡頭手機?

既然Google已經證明可藉由軟硬體配合發揮更好相機拍攝表現,為什麼品牌廠商還是持續推行雙鏡頭,甚至超過3鏡頭以上手機產品?原因很簡單,因為要實現像Pixel 3那樣的拍攝效果,顯然必須額外搭載一組獨立處理器,因此多半會增加手機設計成本,另一方面則是端看手機相機設計需求而定,例如Pixel 3在前置相機採雙鏡頭模組設計,原因在於超廣角鏡頭與一般廣角鏡頭拍攝結果,難以透過單組鏡頭實現,在這樣的情況下就必須採多鏡頭切換拍攝。

同時因為直接採用不同鏡頭規格,可以輕易地滿足景深資訊擷取、拍攝廣角或遠距影像,在拍攝功能設計僅需切換不同鏡頭操作,應用在一般入門或中階手機產品的話,相對能有較快生產效率,同時整體成本考量也較具優勢,除非日後在軟體演算效率與硬體配合有更大進展,或是VPU等獨立運算元件成本大幅降低,否則對於非旗艦等級手機而言,透過多鏡頭滿足各類拍攝需求會比較容易實現。

▲ 三星日前揭曉的4鏡頭主相機手機:2018年款Galaxy A9。

因此從三星近期推出搭載4鏡頭主相機的2018年款Galaxy A9,其實就是透過多鏡頭設計滿足不同拍攝需求,其中更透過超廣角、遠距鏡頭滿足單一鏡頭無法實現拍攝效果。

至於Google是否對多鏡頭模組設計不感興趣?其實也不盡然,實際上內部確實有多鏡頭模組測試,例如在這次推出的Pixel 3系列便在前置相機採雙鏡頭設計,滿足單一鏡頭難以同時實現廣角、超廣角兩種拍攝模式,而未來如果有更多拍攝需求的話,其實也不排斥在主相機導入多鏡頭設計。

未來手機會持續朝向多鏡頭設計嗎?

若是考慮軟體運算與硬體切換效益,以及實際拍攝需求考量,理論上多鏡頭相機發展應該會是未來趨勢,畢竟再考量未來諸如擴增實境、影像識別等應用,在硬體效能尚未有大幅度提昇情況下,多鏡頭設計應該還是未來發展方向,藉由多鏡頭輔助也能減緩影像資訊擷取時所耗費運算效能,進而提昇整體運算效率。只是鏡頭越多並不代表能帶來更好拍攝效果,主要還是看實際拍攝使用需求,以及產品本身訴求體驗,否則單方面增加鏡頭數量,除了額外增加耗電,更可能讓手機內部空間安排變得複雜,甚至佔用電池擺放空間。

▲ LG V40 ThinQ在主相機採用一般廣角、超廣角與遠焦鏡頭,視訊鏡頭則採用不同廣角設計的兩組鏡頭構成。

因此在正常設計之下,主流手機相機鏡頭數量應該還是會控制在1-2組,除非像P20 Pro、Mate 20系列、V40 ThinQ、2018年款Galaxy A9有特殊使用需求,使得相機數量增加至3-4組。

以目前Google看法而言,自然還是維持以單一鏡頭滿足絕大多數拍攝需求,但在明年推出的Pixel新機是否還會維持單一鏡頭設計,就看屆時市場技術發展與實際需求而定。

廣告

Mashdigi

出生自台灣高雄的楊又肇,以前聯合新聞網 (udn.com)數位頻道主編,以及在各網站頻道以本名或Mash Yang名稱維持提供撰寫、授權內容等身分,持續在網路、科技相關活動、展覽出沒。撰寫內容涵蓋個人感興趣內容,包含手機、網路、軟體、零組件,以及科技市場動態,另外也包含各類惡趣味內容,並且持續關注蘋果、微軟、Google、Intel、AMD、Nvidia等經常在你我生活中出現的科技廠商動態。

網友評論 0 回覆本文